Endereço

Rua Bazilio da Silva, 209 - Apto 131-B - CEP: 05545-010 - São Paulo -SP

CNPJ: 32.412.810/0001-41

Endereço

Rua Bazilio da Silva, 209 - Apto 131-B - CEP: 05545-010 - São Paulo -SP

CNPJ: 32.412.810/0001-41

Ei, você aí, parou pra pensar no que tá rolando com a nossa realidade? Pois é, num mundo onde um vídeo pode te fazer acreditar que o presidente tá dançando funk no Planalto ou que sua avó virou estrela de pornô sem nem piscar, a verdade parece um castelo de cartas prestes a desabar com um sopro de pixels falsos. Imagina só: você vê um clipe do seu ídolo confessando um crime que nunca cometeu, e bum! A multidão já tá no pé da cruz.

Essa é a era da IA, amigo, onde o falso se disfarça de verdadeiro como um camaleão no meio da selva digital. Mas calma, não é só pânico por aqui. Vamos mergulhar nessa bagunça pra entender se a detecção de deepfakes pode ser o escudo que salva a gente dessa loucura toda. Ufa, que viagem, né? Vamos nessa, passo a passo, porque o negócio é sério e merece uma boa desvendada.

Pode a Detecção de Deepfakes Salvar a Autenticidade na Era da IA?

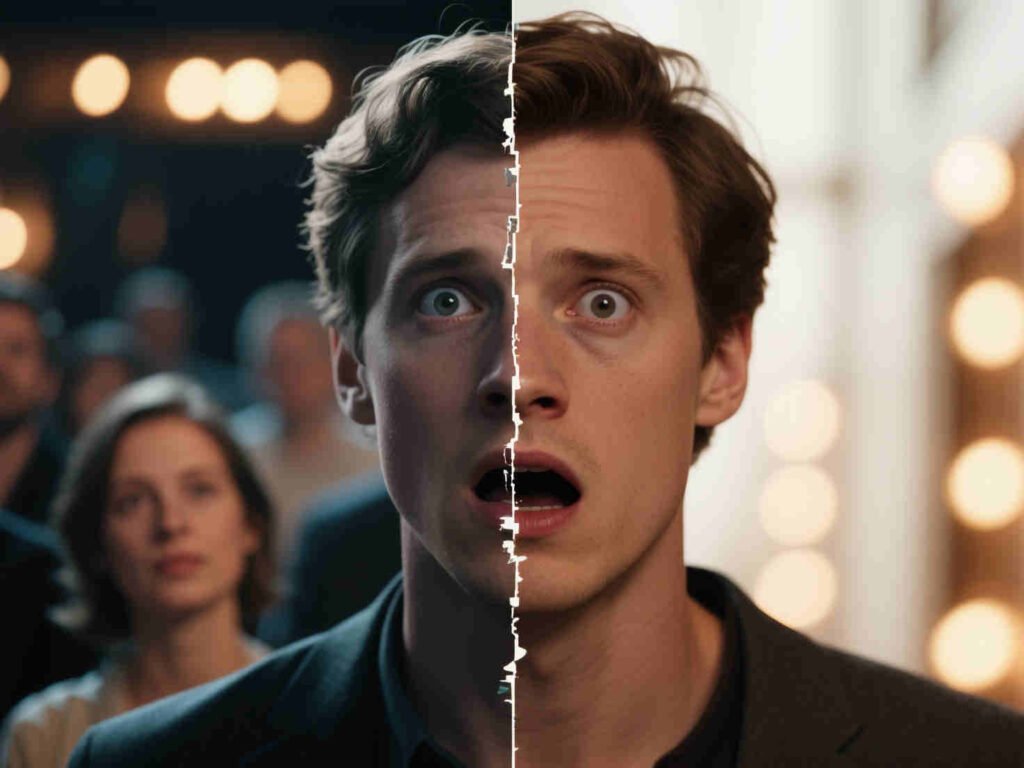

Olha só, antes de tudo, vamos botar as cartas na mesa: o que diabos é um deepfake? É tipo um truque de mágica high-tech, sabe? Aquela ilusão onde o mágico tira um coelho da cartola, mas aqui o coelho é o rosto de alguém colado no corpo de outro, com voz e tudo, parecendo mais real que novela das nove. Deepfake vem de “deep learning”, que é o cérebro por trás da IA, misturado com “fake”, óbvio, porque é tudo mentira bem vestida.

Pois é, esses monstrinhos digitais usam redes neurais – imagine bilhões de neurônios artificiais trabalhando como uma formiga operária incansável – pra criar vídeos, áudios ou imagens que enganam até o olho mais treinado. Não é brincadeira: um deepfake pode fazer o Obama xingar como um marinheiro ou o Bolsonaro dançando samba com o Lula, tudo sem eles moverem um dedo.

Agora, pra não ficar só na teoria, pensa nisso como um espelho torto que reflete não o que é, mas o que a gente quer ver – ou teme ver. E o pior? Tá em todo lugar: no TikTok, no WhatsApp, nas redes sociais. Ah, e não para por aí. Esses deepfakes não são só paquera inocente; eles mordem forte quando usados pra machucar. Mas antes de entrar nos estragos, vamos voltar no tempo, porque nada surge do nada nessa vida.

Pois é, os deepfakes não caíram do céu ontem. Tudo começou lá por volta de 2017, quando um usuário do Reddit, apelidado de “deepfakes”, começou a postar vídeos pornôs falsos com rostos de atrizes famosas colados em cenas adultas. Imagina o baque: de repente, a galera percebe que com um pouquinho de código e um computador bom, dá pra brincar de Deus com as imagens. Foi tipo acender um fósforo num barril de pólvora – bum!

A coisa explodiu. Antes disso, já tinha uns experimentos com IA gerando rostos falsos, mas era mais brincadeira de nerds no porão. Aí, com o boom das GANs – Redes Generativas Adversariais, que é como dois ladrões treinando um pro outro pra roubar melhor –, os deepfakes viraram mainstream.

Avançando pro presente, em 2025, a coisa tá voando. Relatórios mostram que até 8 milhões de deepfakes circulam online por ano, dobrando a cada seis meses, como uma praga que se multiplica sozinha. No Brasil, por exemplo, já rolaram casos de deepfakes políticos e até de nudez forjada pra humilhar mulheres – uma vergonha, né?

É como se a evolução da tecnologia fosse um trem desgovernado, acelerando rumo ao caos, prenunciando um futuro onde ninguém mais confia no que vê. Ironia das ironias: a IA que nos prometia um mundo mais inteligente agora nos deixa duvidando de tudo, como um amigo mentiroso que conta história tão bem que você quase acredita.

E olha, não é só história antiga. Hoje, apps gratuitos no celular permitem criar deepfakes em minutos. Uau! É acessível como pedir um Uber, mas o preço é a nossa sanidade coletiva. Essa jornada temporal nos mostra que o que começou como curiosidade virou arma, e rápido demais pra gente reagir.

Agora, vamos destrinchar o motor dessa máquina infernal. No fundo, um deepfake é como um pintor talentoso que copia traços: a IA pega milhares de fotos e vídeos da pessoa alvo – tipo, selfies suas no Instagram – e treina um modelo pra mapear expressões, movimentos de boca, até o jeito de piscar. Aí, com outra rede rival, ela gera o falso e compara com o real, refinando até ficar indistinguível. Imagina um duelo de boxe: um soco falso que acerta em cheio porque treinou mil vezes no espelho.

Pra áudio, é parecido: sintetiza voz com amostras, fazendo o cara soar como se estivesse ali, sussurrando segredos ou gritando mentiras. E em tempo real? Já tem tech que faz isso ao vivo, como um ator de dublando você na hora. Zzzip! O som sai falso, mas parece eco da sua própria garganta. No Brasil, empresas como a Serpro tão investindo pesado nisso pra prevenir fraudes, mas o mal já tá solto. É hipérbole dizer que é o fim do mundo? Talvez não, porque quando a falsidade vira rotina, a verdade some como fumaça no vento.

Ai, ai, agora vem a parte que dói no peito. Os deepfakes não param na tela; eles invadem a vida real, bagunçando tudo como um furacão em copo d’água. A sociedade, que já tava frágil com fake news, agora enfrenta um inimigo invisível, personificado na forma de rostos sorridentes mentindo descaradamente. Vamos ver os estragos, um por um, porque ignorar é pior que fingir que não vê.

Pensa nas eleições: o momento sagrado da democracia, onde o voto é rei. Aí chega o deepfake e transforma tudo num circo de horrores. No mundo todo, já rolou de candidatos serem “flagrados” em escândalos falsos, manipulando votos como marionetes. Nos EUA, em 2024, um deepfake do Biden “avisando” eleitores errados quase bagunçou a parada.

Aqui no Brasil, pro 2024, o TSE proibiu o uso de IA pra criar conteúdos falsos, mas e aí? A galera ainda compartilha no zap sem checar. Imagina um vídeo de um presidente prometendo mundos e fundos que nunca vai cumprir – ou pior, confessando corrupção ou um crime que não existe. É como um lobo uivando disfarçado de cordeiro, enganando o rebanho inteiro.

E o impacto? Desinformação em massa, polarização que explode como pipoca no micro-ondas. Estudos mostram que deepfakes podem balançar até 20% dos indecisos em eleições.

Agora, vira pro lado pessoal: sua cara, sua voz, tudo virando commodity. Deepfakes de pornô não consensual explodiram, atingindo principalmente mulheres – 96% dos casos, segundo relatórios. Imagina acordar e ver seu rosto em um vídeo safado circulando na net. É violação pura, como se te despissem na praça pública sem consentimento. No Brasil, leis como a LGPD tentam proteger, mas a IA corre mais rápido que a justiça.

E não para aí: stalkers usando deepfakes pra criar áudios falsos de vítimas pedindo ajuda, ou empresas vendendo “você” pra anúncios. Sua identidade, outrora um tesouro pessoal, agora é argila nas mãos de algoritmos famintos. Ironia cruel: a tech que conecta o mundo nos isola no medo, nos fazendo questionar cada selfie como uma armadilha.

Por último, o baque financeiro. Deepfakes em chamadas de vídeo: um golpista finge ser o CEO da empresa pedindo transferência de milhões. Em 2025, fraudes assim causaram bilhões em prejuízos globais, com 1 em 20 verificações de identidade falhando por deepfakes. No Brasil, bancos já alertam: “Ei, não caia nessa!” Mas e o idoso que transfere a poupança pro “filho” falso? Coração partido e conta zerada.

É como um ladrão que entra pela janela invisível, sussurrando “confie em mim” com a voz do seu chefe. Hipérbole? Não, realidade crua, onde o dinheiro voa mais rápido que pássaro assustado.

Já falamos em outro artigo aqui no site sobre o Golpe de pessoas que ligam para você, se passam por gerente do seu banco, ou INSS para fazer prova de vida. Pedem para fazer video conferência, pegam sua imagem e conseguem utilizar sua biometria facial para acessarem sua conta bancária.

Mas ei, nem tudo é trevas! A boa notícia é que a humanidade não fica parada; ela contra-ataca. A detecção de deepfakes é como um detetive farejando pistas minúsculas, usando IA contra IA num duelo épico. Vamos ver como isso rola, porque esperança é o que nos move nessa dança maluca.

Hoje, as ferramentas de detecção são afiadas como navalha. Uma delas é o “liveness detection”, que checa se o rosto tá vivo de verdade – piscadas irregulares, pulso na veia, coisas que deepfake ainda tropeça. Empresas como Intel e MIT criaram detectores que analisam artefatos: bordas borradas, sombras erradas, como um quadro falso que delata o pincel apressado. No Brasil, o Serpro tá na frente com modelos de IA que flagam deepfakes em tempo real.

Apps como o DeepFake-o-meter usam machine learning pra dar nota de veracidade, e óculos de realidade aumentada já testam marcas d’água invisíveis em vídeos reais. Imagina: um selo digital que grita “isso é autêntico!” como um alarme estridente. Aliteração à parte, é progresso que faz o coração bater mais forte.

Só que, ufa, não é moleza. Os deepfakes evoluem mais rápido que os detectores – é uma corrida de ratos, com o rato sempre um passo à frente. Viés racial: detectores falham mais em peles escuras, perpetuando desigualdades como um ciclo vicioso. E deepfakes em áudio? Ainda é um buraco negro, com vozes sintéticas passando batido 70% das vezes.

Desafios éticos também: quem decide o que é “real”? Governos regulando IA podem virar censura disfarçada. No futuro próximo, prenúncio de batalhas judiciais onde um vídeo “culpado” absolve inocentes. É como lutar com sombras: você acerta uma, e dez surgem.

Olhando pro amanhã, o céu tá nublado, mas com raios de sol. Especialistas preveem que até 2030, blockchains vão ancorar conteúdos reais, criando uma “cadeia de custódia” digital inquebrável. IA ética, treinada pra transparência, pode virar o jogo, mas depende de nós: educação digital nas escolas, leis globais como as da UE já em vigor.

No Brasil, com o TSE na cola, eleições 2026 podem ser mais seguras, mas o risco de deepfakes em crimes comuns persiste. Símile perfeito: é como navegar num mar tempestuoso com bússola falha – precisa de capitães atentos. O futuro da autenticidade? Depende se a detecção avança mais que o engano, ou viramos um mundo de ecos vazios.

Pois é, chegamos ao fim dessa odisseia digital, e o que sobra é uma pergunta no ar: pode a detecção salvar a gente? Sim, mas só se corrermos mais rápido. A verdade, essa senhora frágil, tá sob ataque feroz, mas com ferramentas certas e consciência coletiva, dá pra erguer muralhas. Não deixe o falso ditar sua realidade; cheque, duvide, proteja. E aí, pronto pra lutar?

Agora, se você tá pensando em blindar sua empresa contra esses perigos cibernéticos, não perca tempo! A Netadept Technology oferece serviços de TI de ponta, com soluções personalizadas em cibersegurança e detecção de deepfakes. Entre em contato agora pelo site netadept.com.br e garanta que sua autenticidade não vire poeira digital. Vamos nessa juntos?

Ah, e pra quem quer mergulhar mais fundo, corre pra Amazon Brasil e pega o livro Deepfakes: The Coming Infocalypse.